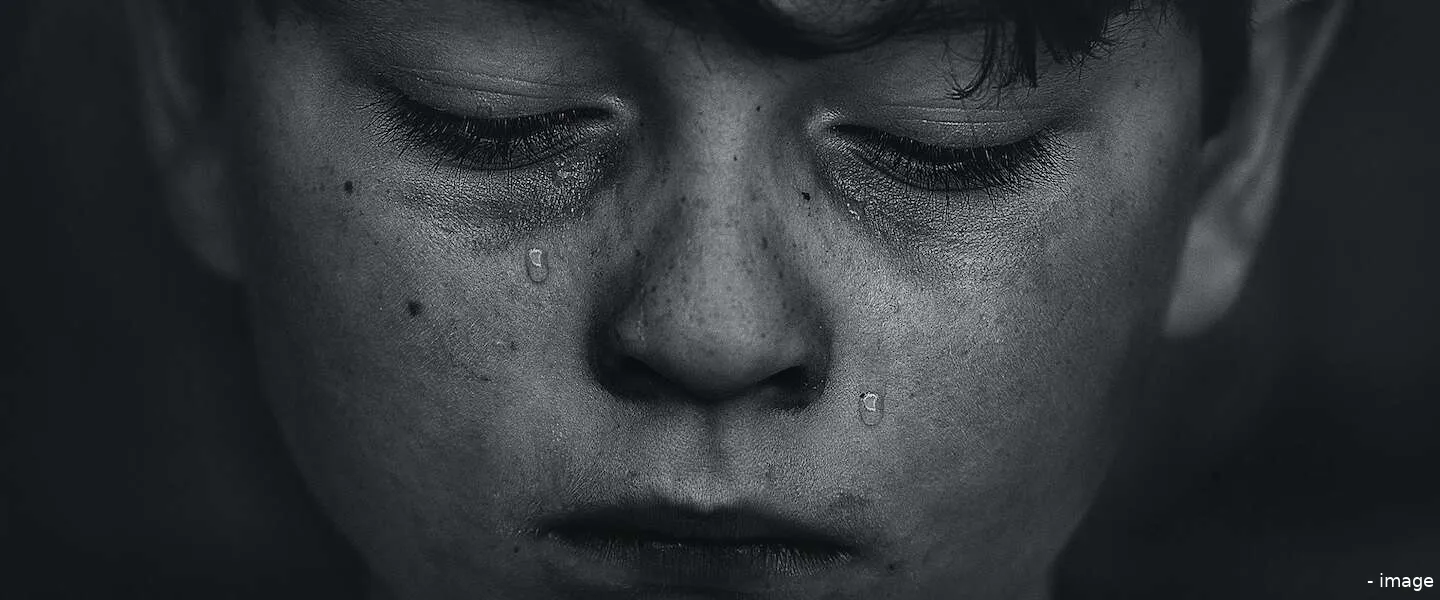

Apple gaat strijd aan tegen kinderporno

Apple werkt momenteel aan een systeem waarmee het bedrijf content die op iOS devices staat kan scannen op de aanwezigheid van kinderporno. Het betreft dan content die aangemerkt wordt als ‘child sexual abuse material’ (CSAM). Het bedrijf zegt er in geslaagd te zijn nu een oplossing te ontwikkelen, NeuralHash genaamd, waarmee dat mogelijk wordt zonder de privacy van haar klanten te schenden.

iCloud blijft privé, NeuralHash scant devices

Omwille van die privacy heeft, en blijft, Apple zich verzetten tegen het scannen van content die gebruikers in iCloud opslaan. Andere clouddiensten, zoals Dropbox, Google en Microsoft, doen dat wel. Apple biedt iCloud klanten de mogelijkheid content versleuteld naar iCloud te sturen en daar wil het bedrijf niet van afstappen.

De oplossing, NeuralHash, die Apple nu gaat implementeren scant content al op het toestel van de gebruiker, voordat het dus (eventueel) in ICloud opgeslagen wordt. Apple rolt het systeem uit vanaf iOS 15 en macOS Monterey. Naar verwachting komen die twee OS-versies binnen enkele maanden beschikbaar. Foto's op de iPhone of Mac van een gebruiker worden door NeuralHash omgezet in een unieke reeks letters en cijfers, ook wel hash genoemd. Elke keer dat een afbeelding enigszins wijzigt, verandert de hash en kan het controleren uitgevoerd worden.

Controle voordat de content naar iCloud geupload wordt

Voordat een afbeelding wordt geüpload naar iCloud-foto's, worden die hashes op het apparaat vergeleken met een database met bekende hashes van afbeeldingen van kindermishandeling, geleverd door kinderbeschermingsorganisaties zoals het National Center for Missing & Exploited Children (NCMEC). NeuralHash gebruikt daarvoor een encryptie techniek, ‘private set intersection’ genaamd, eenhash-overeenkomst te detecteren zonder te onthullen wat de afbeelding is of de gebruiker te waarschuwen.

Wanneer bij die controle materiaal ontdekt wordt die duidt op seksueel misbruik van kinderen zal het bestaan daarvan worden gemeld bijwetshandhavers op een manier die volgens Apple de privacy van de gebruiker beschermt. De upload van die content wordt vervolgens voorkomen, onder andere door de content te verwijderen. Het systeem controleert achteraf ook of de content echt verwijderd is.

De technische details (pdf) en een beschrijving van de werking van NeuralHash zijn op de website gepubliceerd over hoe NeuralHash werkt. Het systeem is inmiddels beoordeeld door cryptografie-experts en wordt al geprezen door kinderbeschermingsorganisaties.

Deel dit bericht

Loading