Techbedrijven moeten samenwerken om deepfakes te kunnen stoppen

Begin dit jaar kwamen ze voor het eerst naar boven: de deepfakes. Dat zijn video's met daarin digitaal vervangen gezichten. In eerste instantie waren die video's in lage resolutie en alleen met een beetje geluk niet van echt te onderscheiden. Nadat de technologie ineens vrij verkrijgbaar was op het net gingen hobbyisten aan de slag en logischerwijs was het vooral porno dat de klok sloeg. Inmiddels zijn we negen maanden verder en is de technologie dusdanig verbeterd dat het steeds moeilijker wordt om een echte video van een gefakete video te onderscheiden. Het gaat inmiddels zo makkelijk dat vieze site Naughty America al munt slaat uit het principe door mensen tegen betaling in hun 'eigen' porno-video te monteren.

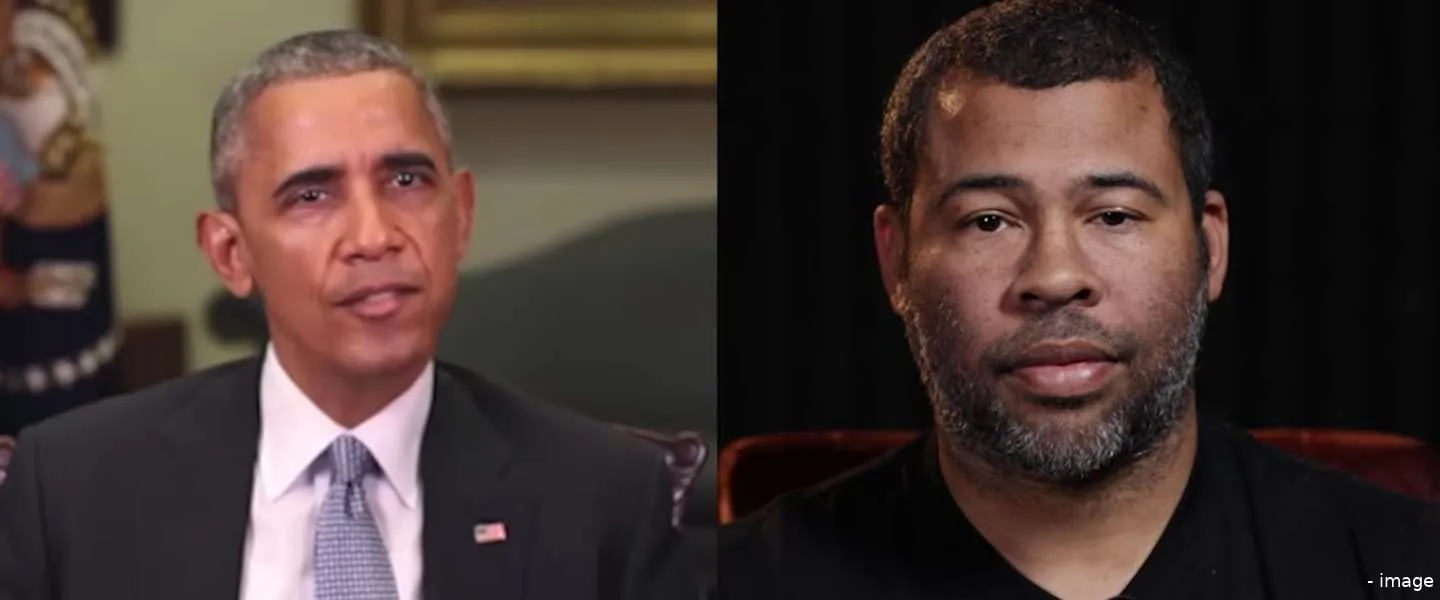

De onderstaande video is een voorbeeld van wat er kan, maar bedenk dan wel dat die al in april dit jaar werd gemaakt, drie maanden na de introductie van de techniek. Daarin zie je Jordan Peele die als president Obama dingen zegt die de echte Obama nooit zou zeggen, maar door zowel de video als de audio aan te passen is het makkelijk om te geloven dat dit een echte video is.

Lastig te herkennen

Facebook, YouTube en alle andere plekken waar media gedeeld kan worden hebben een plan nodig en wel pronto. In het Amerikaanse Huis van afgevaardigden zijn er deze maand al vragen gesteld aan de grote techbedrijven over de technologie, waarvan de voornaamste is "wat gaan jullie er tegen doen?" Het is te makkelijk om een campagne te ontsporen door een goed getimede deepfake van een kandidaat te 'lekken' en dan is diegene wel even bezig om te bewijzen dat de beelden bewerkt zijn. En zelfs dan: als de video er eenmaal is, zijn er altijd mensen die het gewoon (willen) geloven, zelfs als daarna blijkt dat het nep is.

Het grootste filosofische probleem met dit alles is dat we straks in een wereld zullen leven waarin je geen enkele nieuwsbron zomaar mag vertrouwen. Alles kan nep zijn: de tekst die je leest, de foto's die je ziet en straks dus ook de video die er bij zit. Wat is dan nog echt?

De ellende is dat alle platformen apart van elkaar bezig zijn met tegenmaatregelen. Het is wel te begrijpen, want als Google heel dichtbij een sluitende oplossing is kunnen ze die als 'ie klaar is in de markt zetten en dat is de denkrichting waar alle grote partijen in zitten. Het gaat echter te langzaam: terwijl al die partijen nog steeds bezig zijn om te kijken hoe ze het nepnieuws van 2016 kunnen voorkomen in de toekomst staan de nepvideo's van 2018 al klaar om verkiezingen in de weg te zitten, celebrities in verlegenheid te brengen en politieke, terroristische of religieuze standpunten kracht bij te zetten met iets dat niet gebeurd of gezegd is.

Onderzoekers achter de schermen

In stilte zijn verschillende onderzoekers bezig met het opzetten van systemen die deepfakes kunnen opsporen, vaak met gebruikmaking van algoritmes die ook in kunstmatige intelligentie worden gebruikt. Het is echter al een aantal keer voorgekomen dat een gepubliceerde paper over het onderwerp (want publiceren moet op een gegeven moment als je niet voor DARPA werkt) de fakers alleen maar heeft geholpen.

Diezelfde onderzoekers zeggen ook dat niet alleen de platformhouders een verantwoordelijkheid hebben om deepfakes tegen te gaan, maar dat het echt door de volledige tech-industrie gedragen moet gaan worden, wil er enige hoop zijn om aangepaste video's te kunnen herkennen. Onze ogen zijn inmiddels al lang niet meer goed genoeg om het verschil te zien, dus hopelijk komt die samenwerking er ook. Anders kunnen we straks net zo goed niets meer geloven dat we zien. Kan dat spreekwoord ook meteen in de prullenbak.

[Afbeeldingen © - Adobe Stock]

Deel dit bericht

Loading