De toekomst van computers?

Zou het mogelijk zijn als we de intelligentie van Einstein, de context van Gandhi en het geheugen van de gehele mensheid geconsolideerd kunnen aanbieden op een hybride computerplatform? Zijn we in staat, in de nabije toekomst, de samenwerking tussen mens en machine te verbeteren en te verbinden zodat we meer intelligente beslissingen kunnen nemen?

Met z’n allen genereren wij dankzij 6 miljard smartphones en 30 miljard sensoren al een jaar of wat enorme bergen data. Een enorme tsunami van data. Om een idee te geven, samen produceren we dit jaar 44 Zettabytes aan data. Dat is 44 met 21 nullen erachter; één Zettabyte is ter vergelijken met 700.000 keer de grootste bibliotheek ter wereld, en dat keer 44. Van al deze data is ruim 95% ongestructureerd (bijv. foto, video, tekst, spraak). In 2025 loopt dit al op naar 160 Zettabytes en de verwachting is dat we over 25 jaar zo rond de 5 Zettabytes per dag genereren!

De klassieke computer is ons gereedschap, misschien wel de mooiste machine die we ooit hebben bedacht. Hij staat ons al bijna een eeuw terzijde. In de jaren twintig van de vorige eeuw begon hij zijn carrière als eenvoudige rekenhulp, waarna we in de jaren vijftig het tijdperk van de programmeerbare computer binnen stapten. Dat tijdperk hebben we eigenlijk nog steeds niet achter ons gelaten.

Al zijn computers vandaag de dag gigantisch veel sneller dan die van zeventig jaar geleden, ze zijn nog steeds gebouwd volgens hetzelfde principe: de Von Neumann-architectuur van processor en geheugen, verbonden door een bus. Opslag en verwerking gebeuren serieel, in een eindeloos heen-en-weer rijdende trein. Niet heel efficiënt.

Je hoeft niet bang te zijn, de klassieke Von Neumann computersystemen op basis van bits verdwijnt niet uit ons leven. Ze gaan samen werken met Artificial Intelligent (AI) computers op basis van neuronen en Quantum computers op basis van qubits.

Nuttige toepassingen moeten gaan op zoek naar het juiste computerplatform via een hybride cloud infrastructuur. We gaan bits, neuronen en qubits bij elkaar brengen; De toekomst van computers: Hybrid Computing.

Classic Computing: Bits

Een bit is de kleinste eenheid informatie, namelijk 0 of 1 waardoor een klassiek computersysteem dit interpreteert als “aan” of “uit.

De wet van Moore stelt dat aantal transistors in een geïntegreerde schakeling door de technologische vooruitgang elk twee jaar verdubbelt. Helaas lopen we echter tegen natuurkundige beperkingen aan. Is de afstand tussen atomen op een chip kleiner dan 2-5 nanometer dan wordt het instabiel. Je kan namelijk atomen niet kleiner maken.

Nano komt van het Griekse woord “Nanos” het betekent dwerg. Nanotechnologie maakt het mogelijk om te werken op het niveau van moleculen en atomen. Eén Nanometer is een miljardste meter (0,000000001 meter). Ik kan je zeggen dat is heel klein. Ter vergelijking: een rode bloedcel is 7000 nanometer, een menselijk haar zo’n 80.000 nanometer en een DNA-string ongeveer 2,5 nanometer dik.

Men is nu al druk bezig met het veranderen de transistor architectuur van een 2D naar een 3D architectuur: FinFET: om zo nog een toekomstige roadmap te hebben voor klassieke computersystemen gebaseerd op de Bit.

Klassieke computersystemen kunnen nog steeds heel erg snel zijn. Laten we voor het gemak het snelste high performance computersysteem ter wereld als voorbeeld nemen: SUMMIT Dit systeem is uitgerust met 9216 CPU’ s (Central Processing Unit,is de centrale processor die alles berekent & opdrachten verdeelt in de computer)

en 27.648 GPU ’s (Graphics Processing Unit, die normaliter gebruikt wordt voor alle videotaken maar ook voor ondersteuning neurale netwerken) met een snelheid van 1.88 triljoen flops (floating point operations per second).

In normale mensentaal; als elk persoon op aarde één calculatie per seconde zou oplossen dan zou het 305 dagen duren dat SUMMIT in 1 seconde kan afronden. Recent is dit systeem nog ingezet en heeft 77 chemicaliën geïdentificeerd die mogelijk de stekeltjes (corona’s) van het Covid-19-virus kunnen verwijderen. Zo zie je maar weer dat klassieke computersystemen nog jaren mee kunnen.

AI Computing: Neuronen

Een neuron is een cel die gespecialiseerd is in het ontvangen en doorgeven van signalen via synapsen.

We zijn met elkaar al een tijdje op zoek naar een zeer efficiënte manier van dataverwerking, opslag en transport, niet serieel maar parallel. Samen betreden wij een interessant domein, de wereld van cognitieve systemen. Deze systemen worden niet geprogrammeerd, maar we leren ze nieuwe dingen aan, zelflerende systemen die ook kan leren van zijn of haar eigen fouten.

We ontwikkelen dus nieuwe technologie op basis van de blauwdruk van het menselijke brein. Een enorm efficiënt netwerk dat ongeveer 20 Watt aan energie verbruikt. Het menselijk brein maakt gebruik van ongeveer (ik kan er een paar miljoen of wat naast zitten) 90 miljard neuronen (processoren) en 100 triljoen synapsen (verbindingen). Om het even in de juiste context te plaatsen, je kan ongeveer 30.000 neuronen kwijt op het puntje van een naald.

Het menselijk brein kan een goede basis leveren voor nieuwe computerarchitectuur. Denk hierbij aan neurale netwerken die gebruikt worden door Deep Learning en Neuromorphic computing.

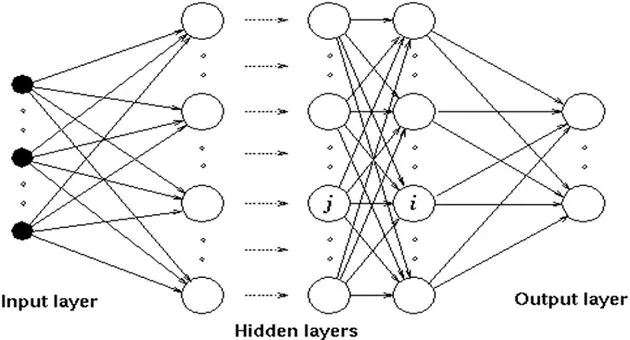

Wat is Deep Learning?

Deep Learning is een technologie die ernaar streeft de menselijke hersens na te bootsen. Het neuron is de kern algoritme van het neurale netwerk. Het netwerk is opgebouwd d.m.v. een input layer, 1 of meer verborgen hidden layers en een output layer. De neuronen die geordend zijn in een onderling verbonden structuur vormen een neuraal netwerk. Elke neuron is verbonden met de inputs en outputs van andere neuronen. Deze systemen kijken naar pixels en herkent welke “aan” en “uit” staat.

Hierdoor zijn de neuronen in staat data (beeld, geluid, tekst) van voorbeelden te ontvangen of de resultaten van andere neuronen door te sturen. Dit is afhankelijk van zijn locatie in het neurale netwerk.

<i><a href=\

Door gebruik te maken van Deep Learning zijn we in staat om systemen dingen aan te leren die in het verleden niet mogelijk waren. Toepassingen zijn te vinden in vertaalprogramma’s, spraakherkenning en beeldherkenning. Vanuit de medische wetenschap richten neurale netwerken zich meestal op het modelleren van het menselijk lichaam, zoals het cardiovasculaire systeem. De mogelijke diagnose kan worden bereikt door een model van het cardiovasculaire systeem van een individu op te bouwen en deze te vergelijken met de fysieke metingen van de patiënt in real time. Als dit regelmatig wordt uitgevoerd, kunnen mogelijke schadelijke aandoeningen in een vroeg stadium worden gedetecteerd.

Neuromorphic Computing

AI chips bouwen waar van de architectuur en ontwerp gebaseerd is op biologische hersenen. Zeer efficiënte zelflerende systemen, die zonder kloksnelheid vele malen efficiënter werken dan onze huidige chips.

Op basis van een kleine 5,4 miljard transistors hebben wetenschappers al 4096 neurosysnaptics cores draaien. Iedere neuro synaptic core heeft zijn eigen geheugen (synapsen), processoren (neuronen) en verbindingen (axons) die net als een menselijk brein als een neuraal netwerk parallel opereren.

Dit noemen we ook wel 3D stacking. Daarnaast kunnen de neurosynaptic cores in parallel verwerken, opslaan en transporteren. Dit in tegenstelling tot de huidige seriële besturing. Inmiddels heeft een gemiddelde neuromorphic chip rond de 1 miljoen neuronen en 256 miljoen synapsen draaien. Maar het beste komt nog, het verbruikt maar 70 milliwatt aan energie “full throthle” ongeveer zo veel als een gehoorapparaat.

Inmiddels kunnen er 16 van deze chips aan elkaar verbonden worden waardoor er 16 miljoen neuronen en 4 miljard synapsen operationeel draaien. De architectuur laat zich dus redelijk eenvoudig opschalen wat interessant kan zijn voor grotere implementaties.

Neuromorphic chips zullen volgens Gartner rond 2025 de dominante computerarchitectuur zijn voor nieuwe, geavanceerde vormen van kunstmatige- intelligentie implementaties, denk hierbij aan bijvoorbeeld zelfrijdende auto’s.

Quantumcomputing: Qubits

Onze huidige computersystemen, ja ook je nieuwste smartphone die je nog maar 1 week in je bezit hebt, maakt gebruik van normale bits die een 0 of 1 kunnen zijn. Een simpel maar doeltreffend serieel proces.

Quantum computers rekenen op een andere manier dan klassieke computers omdat ze gebruik maken van de tegendraadse wetten van de quantumfysica (dit is de theorie die de natuur beschrijft op de kleinst mogelijke schaal). Een quantum computer daarentegen maakt gebruik van qubits (quantum qit). Een qubit kan een 0 of een 1 zijn, of 0 en 1 op hetzelfde moment. Dit fenomeen wordt ook wel “superpositie” genoemd.

Quantumverstrengeling is een ander fenomeen uit de quantumfysica waarbij twee of meer natuurkundige objecten zodanig verbonden zijn, dat het ene object niet meer volledig beschreven kan worden zonder het andere specifiek te noemen - ook al zijn de beide objecten ruimtelijk gescheiden.

Naast “superpositie” en “entanglement” hebben we nog een derde bouwblok namelijk “Interferentie”. Interferentie stelt ons in staat de kans op het krijgen van het juiste antwoord te vergroten en de kans op het verkeerde te verkleinen.

Dat geeft ook een verschil aan met klassieke computers, aangezien bij quantum algoritmen je een programma meerdere keren moet laten lopen om het “beste” antwoord te krijgen. Bij klassiek krijg je een “exact” antwoord.

Door deze Qubits in superpositie te verstrengelen (entanglement) in relatie met interferentie kan door deze combinatie 2ˆn verschillende staten aannemen, waarbij n het aantal verstrengelde qubits vertegenwoordigt. Met twee entangled Qubits heb je vier staten, met drie Qubits acht en met vier qubits zestien etc. Door superpositie, verstrengeling en interferentie samen stijgt de capaciteit van quantum computers exponentieel waardoor deze in staat is snelle parallelle berekeningen uit te voeren die met onze huidige computers niet mogelijk is.

De huidige universele quantum systemen bestaan ongeveer uit 53 qubits maar zijn nog niet heel erg stabiel. Quantum systemen zijn namelijk heel gevoelig voor verstoring van buitenaf, Daarom worden de meest huidige universele quantum computers gekoeld naar -273 graden onder nul, dat is net iets boven het absolute 0 punt. Ik hoor je al denken, dat is heel koud. Om het in de juiste context te plaatsen, in de ruimte is het ongeveer -270 graden onder nul. Daarom geloof ik op dit moment nog niet dat je een quantum chip in je smartphone kunt hebben, heb je verdomd dikke wanten nodig.

De uitdaging ligt met name om de decoherence tijd zo kort mogelijk te houden.Fouten komen voort uit “de-coherence” een proces waarin omgevingsfactoren zoals straling, trillingen, temperatuurveranderingen etc. interacteren met de qubits en daardoor oncontroleerbaar hun kwantumtoestanden verandert en ervoor zorgt dat informatie door de computer verloren gaat. Op dit moment is de stabiele tijd (coherence) van een quantumcomputer ongeveer 100 microseconden. Er is dus nog veel onderzoek nodig om dit op te lossen.

Toepassingen die exponentiele rekeningkracht nodig zullen hebben en die mogelijk gebruik gaan maken van quantumcomputers zijn bijvoorbeeld; Medicijnonderzoek, nieuwe batterijen met alternatieve chemische bestanddelen voor elektrische auto’s en het versnellen van machine -en deep learning toepassingen (Dit zou een quantumcomputer natuurlijk nog sneller kunnen dan een klassiek systeem, aangezien parallellisatie het leerproces enorm kan versnellen). Deze voorbeelden zijn op dit moment nog allemaal in fundamenteel of toegepast onderzoek.

Voor wie geïnteresseerd is om te experimenteren met een echte quantumcomputer: zie Quantum Experience voor researchers, developers en programmeurs.

Hybrid Computing, de toekomst van computing?

Nuttige toepassingen zoeken dus het juiste computerplatform via een hybride cloud infrastructuur. We gaan bits, neuronen en qubits bij elkaar brengen, op verzoek van een eindgebruiker om de juiste toepassing automatisch toe te wijzen naar een juist platform, of een combinatie van platformen, zonder dat de eindgebruiker weet op welk platform zijn uiteindelijke input en output wordt verwerkt.

Een beveiligde, heterogene computerarchitectuur die de wetenschap kan helpen met oplossingen die in het verleden niet mogelijk waren en bedrijven en individuen te helpen met maatschappelijk relevante oplossingen te bieden. We zien een natuurlijke progressie waarbij een intelligent, geautomatiseerd selectiemechanisme bits, neuronen en qubits combineert om kennis op te nemen, hiaten in kennis te identificeren, potentiële materiaalkandidaten af te leiden en een optimale multi-fysieke simulatie stroom te configureren en te optimaliseren.

Bits, neuronen en qubits zijn separaat ongelofelijk krachtig, maar we moeten juist de combinatie van alle drie nog doorgronden.

Het gaat dus niet om de strijd tussen mens en computer maar juist om de symbiose tussen slimme creatieve computers en slimme mensen om de wereld weer een beetje mooier en leefbaarder te maken. Of zoals Gandhi zei “Het is onwijs al te zeker te zijn van je eigen wijsheid. Het is gezond eraan te denken dat zelfs de sterkste mensen kunnen verzwakken en zelfs de wijste mensen kunnen dwalen”

[Fotocredits © putilov_denis - Adobe Stock]

Deel dit bericht

Loading