'De AI Overviews van Google liegen miljoenen keren: per uur'

Google introduceerde vorig jaar de AI Overzichten, ook wel AI Overviews. Het zorgt ervoor dat wat je zoekt op de zoekmachine al binnen Google wordt beantwoord op basis van artikelen die echte mensen hebben geschreven, maar waarvoor ze dan geen credit krijgen in de vorm van verkeer naar hun website. Dit nemen van informatie is echter niet het enige grote nadeel aan AI Overviews: ze blijken de boel alleen in een uur tijd al miljoenen keren bij elkaar te liegen.

AI Overviews

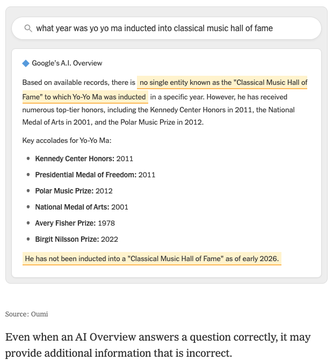

AI Overviews heeft het volgens onderzoek in 90 procent van de gevallen bij het rechte einde. Het onderzoek is verricht door The New York Times om te bekijken hoe accuraat die AI Overviews zijn. Het betekent dus dat van de 10 vragen die je stelt, 1 vraag verkeerd wordt beantwoord. Afhankelijk van wat je verder met dat antwoord doet kan dat problematisch zijn. Bovendien staat er wel Google boven, en verwacht je daarbij toch een bepaald betrouwbaarheid, waardoor je het antwoord waarschijnlijk eerder voor zoete koek slikt als wanneer het bijvoorbeeld van ChatGPT zou komen.

De New York Times verrichte zijn onderzoek met Oumi, een startup die AI-modellen ontwikkelt. Het gebruik AI-tools om allerlei vragen aan AI Overviews voor te leggen en te evalueren. Ook is SimpleQA gebruikt, een tool van OpenAI waarin meer dan 4.000 vragen zitten die je kunt checken met het antwoord van AI. Het heftige is dat dit dus een vrij standaard, trainbare vragenlijst is, maar ook daar bleek AI overviews niet zo accuraat te zijn. Tegelijkertijd is het ook belangrijk om rekening te houden met de schaal: het is al snel miljoenen als er elk uur over de hele wereld zoekopdrachten worden gedaan.

AI-overzichten op Google

Bij Gemini 2.5 was er nog 85 procent accuraatheid, maar inmiddels is dat dus niet heel veel beter geworden: ondanks dat Gemini 3 er nu is, komt er een accuraatheid van 91 procent uit. Wel wisselt AI Overviews tussen verschillende modellen, afhankelijk van de vraag die wordt gesteld. Maar volgens het onderzoek van de New York Times is in de paar minuten dat je dit artikel leest al honderdduizenden keren een verkeerd antwoord uit AI Overviews komen rollen. Niet dat Google overigens zegt dat zijn AI het altijd bij het rechte eind heeft: je moet altijd zelf kritisch blijven denken als je kunstmatige intelligentie gebruikt.

Google vindt deze test overigens niet goed: dat zegt eigenlijk op alle externe tests dat het er niet mee eens is. Tegen de Times zegt een woordvoerder dat SimpleQA incorrecte informatie bevat. ‘Er zitten gaten in deze studie en het is geen goede representatie van wat mensen zoeken op Google.’ Daarnaast geeft AI Overviews dus ook heel veel goede antwoorden: er zijn AI-tools die het veel slechter doen. Het is alleen vooral een reputatieding: bij Google verwacht je eigenlijk altijd wel een betrouwbaar antwoord. Toch blijft dus ook hier het devies: AI kan fouten maken, dus dubbelcheck altijd het antwoord even.

Lees ook

Deel dit bericht

Loading