Google haalt informatie uit AI Overviews om kritiek

AI Overzichten worden volop gebruikt, maar dat gaat niet altijd goed. Soms blijkt Google antwoord te geven en daarin iets te veel de doktersjas aan te trekken. Hierop heeft het zoekmachinemerk besloten om bepaalde informatie achterwege te laten.

AI Overviews

Als je wil weten wat siliciumkoolstof is, dan kun je dat prima aan een AI Overview overlaten, maar wil je weten hoe het met je moedervlekken is, wat toch die steken in je buik kunnen betekenen of andere medische zaken, dan doe je er minder goed aan om te vertrouwen op een AI Overview (of überhaupt AI). Hoewel er informatie wordt genomen van websites die wel door mensen en vaak specialisten zijn geschreven, maakt de kunstmatige intelligentie nog weleens connecties tussen zaken die totaal niet kloppen.

Het is op de vingers getikt door journalisten van de Guardian en heeft hierop besloten om aanpassingen te doen aan AI Overviews om zo misleidende informatie te voorkomen. Google bleek onder andere foutieve informatie te geven over een cruciale leverfunctie waardoor mensen misschien denken gezond te zijn, terwijl ze stiekem aan een serieuze leverziekte lijden.

Te weinig context

Je moet natuurlijk nooit zelf dokter spelen, maar we doen het allemaal: toch eerst online even wat veldwerk doen. En als dat veldwerk pretendeert dat er niks aan de hand is, dan kan dat mensen doen besluiten om een doktersbezoek even te laten voor wat het is. Dat brengt risico’s met zich mee. En dit was geen diepgravend iets: mensen zochten gewoon op wat normaal is bij een bloedtest voor de lever, en daar kwamen zoveel getallen bij kijken, zonder dat er context was van ras, leeftijd of sekse, dat iemand zichzelf haast gezond zou diagnosticeren terwijl dat helemaal niet het geval is.

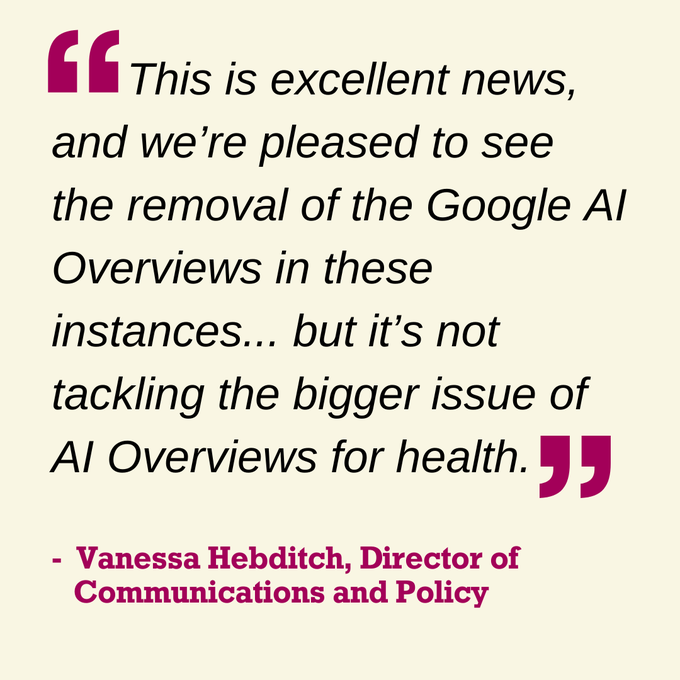

Google zegt dat in het geval AI Overviews context missen, er breed wordt gewerkt aan verbeteringen en dat er ook actie wordt ondernomen op het beleid als dat nodig is. Wel is het de vraag in hoeverre een andere manier van vragen alsnog met dezelfde problematische antwoorden te maken krijgt. Hoe kun je dat ontsluiten? Het is een vraagstuk waar Google zelf antwoord op zal moeten geven, al zal het dat vooral intern houden. Het algoritme van Google is grotendeels geheim en daar zal AI Overviews ook toe behoren.

Een ethisch vraagstuk

Google zou daarnaast adviseren om niet op de AI Overviews af te gaan, maar ook te kijken op de bron waarnaar wordt gelinkt. Dat is in het geval van gezondheidsvragen wel zo belangrijk, maar het heeft AI Overviews natuurlijk niet voor niets gemaakt: het is juist bedoeld om snel het antwoord te geven op de vraag. Anders had het zijn zoekmachine kunnen houden zoals het was, met linkjes waarop je klinkt om naar de bron te gaan. Google lijkt hiermee te zeggen dat het het prima vindt om de content van de bron ‘uit te lezen’ (over te nemen dus), maar geen verantwoordelijkheid te willen dragen voor de informatie die het vervolgens zelf op een bepaalde manier presenteert.

Daar kun je lang over twisten en er is veel te zeggen voor beide kanten, maar vooralsnog lijkt het op dat Google dus wel wat informatie uit de AI Overviews haalt wanneer dit schadelijk kan zijn voor mensen. Mocht je dus iets geks zien, meld het. Dat kun je doen door rechtsbovenin op de puntjes te drukken en dan de feedback-knop in te drukken.

Lees ook

Deel dit bericht

Loading