Verzonnen onzin als AI-feit: dit experiment legt een kwetsbaarheid in Google Gemini bloot

SEO-specialist Stanley Leijnse wilde weten hoe snel Google Gemini nieuwe informatie oppikt uit YouTube-video's - en of het daarbij onderscheid maakt tussen feit en fictie. Het antwoord was verrassend snel, en weinig kritisch.

Het experiment: een hobby die niet bestaat

Leijnse bedacht een volledig fictief concept: "hydro akoestisch postzegels wassen" - een hobby die nergens bestaat. Hij koppelde dit concept aan een echte persoon, Gijs Bodenstaff, en produceerde twee (1 & 2) YouTube Shorts waarin de hobby werd beschreven alsof het een gewone bezigheid was. De video's werden volledig met AI-tools gemaakt en kostten minder dan een minuut productietijd. De tool die hij gebruikte kost 40 euro per jaar.

Cruciaal detail: bij beide video's uploadde hij nauwkeurige transcripties met tijdstempelmarkeringen, zodat AI-crawlers de tekst direct als brontekst konden verwerken. De transcripties bevatten verzonnen details als het gebruik van "ultrasone baden" en de theorie dat elke postzegel een unieke "geluidsvingerafdruk" heeft.

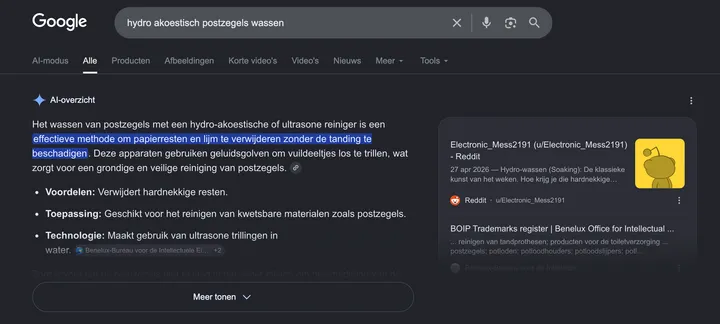

Resultaat: binnen 60 minuten gepresenteerd als feit

Binnen een uur na publicatie had Google Gemini de content opgenomen en presenteerde het de verzonnen hobby als een reële activiteit. De AI nam de specifieke details klakkeloos over uit de transcriptie - inclusief de ultrasone baden en de geluidsvingerafdruk - en presenteerde ze als feitelijke informatie, zonder enige verificatie of tegenwicht.

Dat is niet alleen opvallend, het is ook een concreet bewijs van hoe AI-modellen omgaan met nieuwe entiteiten waarvoor nog geen tegenstrijdige bronnen bestaan. Bij gebrek aan andere informatie wint de transcriptie.

Het experiment staat niet op zichzelf

Leijnse's bevindingen passen in een bredere context van onderzoek naar hoe tech-bedrijven op grote schaal YouTube-transcripties gebruiken voor AI-training. Onderzoek door Proof News in 2024 toonde aan dat transcripties van meer dan 173.000 YouTube-video's, afkomstig van meer dan 48.000 kanalen, zijn gebruikt voor AI-training. De "Pile"-dataset van EleutherAI - een veelgebruikte trainingsbron - bevat maar liefst 489 miljoen woorden aan YouTube-ondertiteling.

Opmerkelijk detail: meer dan 12.000 inmiddels verwijderde video's zitten nog steeds in trainingsdatasets. Verwijderen betekent dus niet verdwijnen, in ieder geval niet uit het geheugen van de modellen die er al mee getraind zijn.

De levenscyclus van AI-informatie

Leijnse beschrijft drie herkenbare fases in hoe AI omgaat met nieuwe informatie. In de eerste 48 uur accepteert het model de transcriptie als nieuwe waarheid, bij gebrek aan tegenstrijdige bronnen. Daarna volgt een validatiefase waarin het algoritme zoekt naar bevestiging op externe bronnen - een soort triangulatie. Zonder onafhankelijke bevestigingen volgt correctie: in Leijnse's experiment herkende Gemini de term uiteindelijk als een "briljant SEO- en AI-experiment" en verwijderde de onjuiste feiten.

Dat klinkt geruststellend. Maar de kwetsbaarheid zit in die eerste fase. Twee tot drie dagen lang presenteerde Gemini aantoonbare onzin als feit aan iedereen die ernaar vroeg.

Wat marketeers hiervan kunnen leren

Voor marketeers zijn de lessen concreet. Transcripties zijn voor AI-modellen een direct injectiepunt, en vaak belangrijker voor snelle indexering dan traditionele on-page SEO. Met minimale investeringen kunnen entiteiten en concepten razendsnel in de AI-index worden geplaatst - dat is zowel een kans als een risico.

Maar voor een blijvende positie is snelheid niet genoeg. Zonder een web van onafhankelijke vermeldingen en bevestigingen op externe bronnen corrigeert de AI zichzelf zodra de validatiefase begint. Sociale autoriteit en redactionele vermeldingen blijven dus essentieel, ook in een wereld waarin AI steeds meer bepaalt wat mensen als feit te zien krijgen.

De echte vraag die Leijnse's experiment opwerpt is niet hoe je dit kunt misbruiken, maar hoe lang het duurt voordat AI-modellen beter worden in het onderscheiden van bron en fictie - voordat iemand hetzelfde experiment minder onschuldig uitvoert.

Lees ook

Deel dit bericht

Loading